Inhoud

Gepresenteerd door: AltaML

Q:

Waarom zijn grafische verwerkingseenheden (GPU's) belangrijk voor diepgaand leren?

EEN:

Het gebruik van grafische verwerkingseenheden (GPU's) is van bijzonder belang voor het gebied van diep leren. De reden heeft te maken met hoe diepe leersystemen zijn opgezet en waarvoor ze zijn bedoeld.

Experts definiëren deep learning als een soort machine learning waarbij algoritmen meerdere lagen gebruiken voor progressieve data-analyse.

Sommigen noemen specifieke voorbeelden, zoals convolutionele neurale netwerken (CNN's) met hun verschillende lagen waarbij max pooling, filtering, padding, striding en andere taken betrokken zijn.

In bredere zin zijn dingen als beeldverwerking en natuurlijke taalverwerking afhankelijk van multi-step, multi-algoritme procedures, waarvan vele lijken op de neurale netwerken die professionals in machine learning leren identificeren en analyseren.

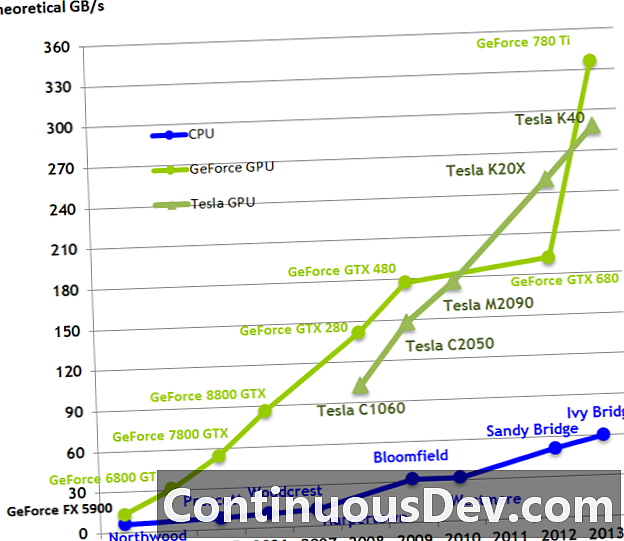

Zoals we in een eerder artikel hebben opgemerkt, worden GPU's over het algemeen gewaardeerd in machine learning vanwege hun parallelle verwerkingscapaciteit. Naarmate machine learning vorderde, evolueerde de hardwarewereld ook van het idee van een individuele sterke CPU-kern naar meerdere eenheden met parallelle verwerking die grote hoeveelheden computationeel werk sneller aankan.

Met diepe leersystemen die generatieve modellen op een hoger niveau omvatten, zoals diepe geloofsnetwerken, Boltzmann-machines en echostaatsystemen, is er een specifieke behoefte aan parallelle verwerking en gespecialiseerd kernontwerp. Je zou kunnen zeggen dat het gebruik van GPU's enigszins vergelijkbaar is met het gebruik van geavanceerde RISC-machines in sommige andere soorten verwerking - dat het aanpassen van chips aan een bepaald gebruik heel logisch is.

Naast het nut van GPU's voor diepgaand leren, zie je ook dat dezelfde typen processoren populair worden in bewegingen in de richting van een fundamentele verandering in de computerstructuur die bekend staat als quantum computing.

Ook hier is het de complexiteit en ordening op een hoger niveau van rekenkracht die de parallelle verwerkingscapaciteit vereist. In quantum computing worden traditionele bits vervangen door qubits, die een waarde van 1, 0 of een niet-gespecificeerde combinatie kunnen hebben. Dit soort "Schroedinger's bit" vormt de basis voor een computermodel dat de wereld van IT op zijn kop kan zetten.

Voor diegenen die geïnteresseerd zijn in opkomende technologieën, zal het van cruciaal belang zijn om te kijken naar het gebruik van GPU's en hun opvolgers in systemen zoals deep learning-netwerken en quantum computing-opstellingen. Beide, zo zeggen veel experts, staan nog in de kinderschoenen en zullen volwassen worden en resultaten opleveren in de komende jaren.