Inhoud

Bron: Kran77 / Dreamstime.com

Afhaal:

Diepgaande leermodellen leren computers zelfstandig te denken, met een aantal zeer leuke en interessante resultaten.

Diep leren wordt toegepast op steeds meer domeinen en industrieën. Van auto's zonder bestuurder, tot het spelen van Go, tot het genereren van beeldmuziek, er komen elke dag nieuwe deep learning-modellen uit. Hier gaan we over verschillende populaire deep learning-modellen. Wetenschappers en ontwikkelaars nemen deze modellen en wijzigen ze op nieuwe en creatieve manieren. We hopen dat deze showcase u kan inspireren om te zien wat mogelijk is. (Zie Computers in staat zijn om het menselijk brein te imiteren voor meer informatie over de vooruitgang in kunstmatige intelligentie?)

Neurale stijl

U kunt uw programmeervaardigheden niet verbeteren als niemand om softwarekwaliteit geeft.

Neurale verhalenverteller

Neurale verhalenverteller is een model dat, wanneer een afbeelding wordt gegeven, een romantiekverhaal over de afbeelding kan genereren. Het is een leuk stuk speelgoed en toch kun je je de toekomst voorstellen en de richting zien waarin al deze modellen met kunstmatige intelligentie bewegen.

De bovenstaande functie is de "stijlverschuivende" bewerking waarmee het model standaard beeldbijschriften kan overbrengen naar de stijl van verhalen uit romans. Stijlverschuiving werd geïnspireerd door "A Neural Algorithm of Artistic Style."

Gegevens

Er zijn twee belangrijke gegevensbronnen die in dit model worden gebruikt. MSCOCO is een dataset van Microsoft met ongeveer 300.000 afbeeldingen, waarbij elke afbeelding vijf bijschriften bevat. MSCOCO is de enige bewaakte gegevens die worden gebruikt, wat betekent dat het de enige gegevens is waar mensen naar binnen moesten en expliciet bijschriften voor elke afbeelding moesten uitschrijven.

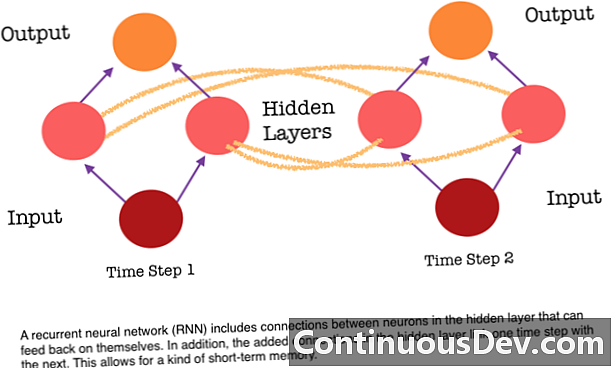

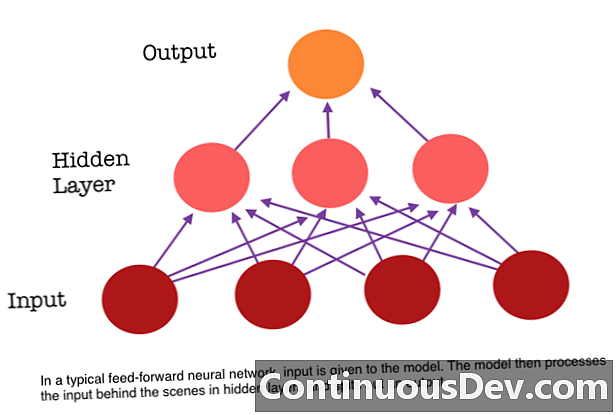

Een van de belangrijkste beperkingen van een feed-forward neuraal netwerk is dat het geen geheugen heeft. Elke voorspelling is onafhankelijk van eerdere berekeningen, alsof het de eerste en enige voorspelling is die het netwerk ooit heeft gedaan. Maar voor veel taken, zoals het vertalen van een zin of paragraaf, moet de invoer bestaan uit opeenvolgende en conisch gerelateerde gegevens. Het zou bijvoorbeeld moeilijk zijn om een enkel woord in een zin te begrijpen zonder de beperking van de omringende woorden.

RNN's zijn verschillend omdat ze nog een reeks verbindingen tussen de neuronen toevoegen. Met deze koppelingen kunnen de activeringen van de neuronen in een verborgen laag zichzelf terugkoppelen bij de volgende stap in de reeks. Met andere woorden, bij elke stap ontvangt een verborgen laag zowel activering van de laag eronder als ook van de vorige stap in de reeks. Deze structuur geeft in wezen terugkerende neurale netwerken geheugen. Dus voor de taak van objectdetectie kan een RNN gebruik maken van zijn eerdere classificaties van honden om te helpen bepalen of het huidige beeld een hond is.

Char-RNN TED

Dankzij deze flexibele structuur in de verborgen laag kunnen RNN's zeer goed zijn voor taalmodellen op tekenniveau. Char RNN, oorspronkelijk gemaakt door Andrej Karpathy, is een model dat één bestand als invoer gebruikt en een RNN traint om het volgende personage in een reeks te leren voorspellen. De RNN kan karakter per karakter genereren dat eruit zal zien als de originele trainingsgegevens. Een demo is getraind met transcripties van verschillende TED Talks. Voer het model een of meerdere sleutelwoorden in en het zal een passage genereren over de sleutelwoorden in de stem / stijl van een TED Talk.

Gevolgtrekking

Deze modellen tonen nieuwe doorbraken in machine-intelligentie die mogelijk zijn geworden door diep leren. Diep leren laat zien dat we problemen kunnen oplossen die we nooit eerder konden oplossen, en dat plateau hebben we nog niet bereikt. Verwacht de komende jaren nog veel meer opwindende dingen zoals auto's zonder bestuurder als gevolg van diepgaande leerinnovatie.